Par Murielle Delaporte – III. Equilibrer performance et dépendance cognitives

Une dépendance stratégique aux architectures numériques

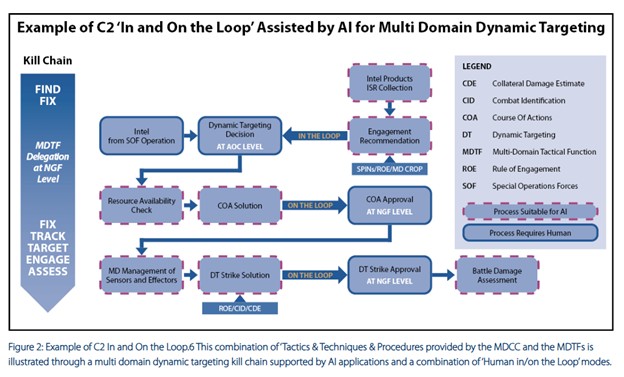

Depuis les premières heures de l’IA qui remontent à plusieurs décennies, le débat sur la frontière entre aide à la décision et décision automatisée n’a de cesse de resurgir. Toutes les armées occidentales insistent sur le principe de prédominance de l’humain dans la boucle, l’homme demeurant seul responsable de la décision finale.

De fait, au sein des doctrines alliées, on distingue généralement les configurations « human in the loop » (l’humain valide chaque action), « human on the loop » (l’humain supervise et peut intervenir) et « human out of the loop » (systèmes capables d’agir sans intervention immédiate), la pression temporelle des opérations tendant à favoriser les formes de supervision plutôt que de validation systématique.

© Joint Air Power Competence Center

Malgré ce cadre, les critiques craignent qu’à mesure que la vitesse des opérations augmente, la pression opérationnelle pousse à déléguer davantage de pouvoir décisionnel aux systèmes. Illustration récente de ce débat aux États-Unis sur les limites de l’utilisation militaire de l’intelligence artificielle, la société Anthropic a en février 2026 refusé d’accorder au gouvernement américain un accès illimité à son modèle Claude, invoquant les risques liés à la surveillance de masse ou à l’emploi dans des systèmes d’armes autonomes[1]. La polémique actuelle ne porte pas sur l’utilisation de l’intelligence artificielle par le Pentagone, déjà largement établie, mais sur le degré de contrôle que les entreprises technologiques entendent conserver sur l’usage militaire de leurs modèles.

L’un des premiers enjeux tient de fait à la dépendance croissante vis-à-vis des architectures numériques qui sous-tendent ces systèmes. Contrairement à une perception parfois simplifiée, les modèles d’IA – de type OpenAI, Anthropic ou Meta aux Etats-Unis – ne sont que des « moteurs cognitifs ». Ils savent produire du texte, analyser des données ou générer des hypothèses. Mais dans un système militaire réel, il faut connecter ces modèles à des bases de données classifiées, des flux de capteurs, des systèmes de commandement et des architectures sécurisées. Les modèles d’IA ne constituent donc pas en eux-mêmes le cœur de la capacité opérationnelle. Ce rôle revient aux plateformes d’intégration, du type de l’AIP de Palantir évoquée précédemment, lesquelles assurent la connexion nécessaire.

Dans cette architecture, les modèles s’avèrent donc en grande partie interchangeables, tandis que la maîtrise de l’infrastructure d’orchestration devient déterminante. Le contrôle de cette brique revient dès lors à détenir un levier central dans la chaîne décisionnelle, soulevant des enjeux majeurs en termes de souveraineté, de dépendance industrielle et de gouvernance de la donnée. C’est là que se trouve la bascule stratégique. Celui qui contrôle la plateforme qui relie les données militaires, les capteurs, les satellites et les outils d’analyse contrôle en réalité l’infrastructure de décision.

Equilibrer souveraineté et interopérabilité

C’est cette question que soulève la révolution en matière de C2 générée par l’IA, alors que cette centralité des plateformes d’orchestration se retrouve dans l’adoption par l’OTAN du Maven Smart System NATO. Ce programme, au sein duquel sont intégrés différents partenaires européens (Safran.AI, Quantum Systems, Hadean) dans le cadre de démonstrations récentes[2], est présenté comme le premier système de commandement et de contrôle de l’Alliance explicitement « augmenté » par l’IA, chargé de fusionner les données multi‑capteurs et d’accélérer les boucles de ciblage au niveau interallié[3].

Même si les différents membres de l’OTAN ne sont pas tous au même niveau technologique, l’anticipation et la technologie permettent de concilier les deux objectifs d’apparence contradictoires que sont la souveraineté (technologique et décisionnelle) et l’interopérabilité indispensable au bon fonctionnement de l’Alliance. Cet équilibre existe dans d’autres domaines et il n’y a pas de raison que le domaine de l’IA fasse exception. En ce qui concerne les forces armées françaises, cette double approche est ainsi décrite par le colonel Bruno de San Nicola, NATEX (National Technical Expert C4I/TransfoNum) au sein de la Représentation militaire et de la défense auprès de l’OTAN, dans un article récent :

« Les choix architecturaux et organisationnels en matière de C2 ne sont jamais neutres. Ils traduisent une vision du commandement, du rôle de la coalition, de la place de la souveraineté nationale et du rapport entre l’humain et la machine. L’adoption par l’Otan du Maven Smart System, le développement par la France d’Artemis.IA [Ndlr : Architecture de traitement et d’exploitation massive de l’information multi-sources et d’IA \] et l’expérience ukrainienne du système Delta illustrent trois réponses distinctes, mais complémentaires, à une même équation stratégique : décider plus vite, sans renoncer à la maîtrise politique de la décision. (…)

Artemis.IA ne s’oppose pas à l’interopérabilité alliée, mais en redéfinit les modalités. Il ne s’agit plus nécessairement de partager la donnée brute ou les algorithmes, mais de produire des informations qualifiées, contextualisées et exploitables, compatibles avec des standards communs, tout en conservant la maîtrise nationale des chaînes de traitement. Cette conception plus exigeante de l’interopérabilité vise à concilier coopération opérationnelle et souveraineté décisionnelle, sans sacrifier l’une à l’autre. (…)

Le futur du commandement et du contrôle ne se jouera ni dans une dépendance exclusive à une solution interalliée, ni dans un repli souverain. Il réside dans la capacité à articuler efficacité collective, maîtrise nationale et agilité opérationnelle. »[4]

Cette réflexion sur l’équilibre entre souveraineté et interopérabilité conduit à élargir la notion même de dépendance stratégique, en ce sens que la souveraineté ne se limite ainsi plus à la maîtrise des flux physiques, à la sécurisation de la chaîne d’approvisionnement et à l’accès aux ressources stratégiques. Elle s’étend dorénavant aux architectures cognitives qui structurent la décision. On peut ainsi parler de l’émergence d’une « supply chain algorithmique », qui demeure très difficile à vérifier, tant les défis sont nouveaux. Cette évolution est en effet d’autant plus critique que la diffusion rapide de certains modèles, notamment via des logiques « open source », introduit des dépendances difficiles à tracer.

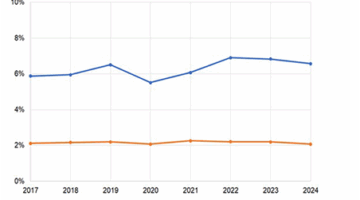

Cette tendance exponentielle est désormais documentée de manière explicite : comme le souligne un article publié le 1er avril 2026 dans War on the Rocks, ces modèles peuvent s’insérer profondément dans les architectures logicielles occidentales, y compris dans des environnements sensibles, tout en restant liés à des cadres juridiques nationaux susceptibles d’imposer des obligations de coopération avec les autorités étatiques. La dépendance ne passe plus seulement par les composants, mais par les logiciels d’IA eux-mêmes, largement diffusés et intégrés dans des systèmes occidentaux, y compris sensibles. Selon les données de plusieurs rapports sur l’IA, la part des modèles chinois dans les usages mondiaux est passée d’un ordre de grandeur proche de 1% fin 2024 à près de 30% fin 2025[5]. Certaines architectures comme Qwen d’Alibaba, ont dépassé les sept cents millions de téléchargements sur les plateformes open source, ce qui en fait l’un des systèmes ouverts les plus diffusés au monde. Contrairement à une vision de « neutralité technique », ces modèles restent étroitement arrimés à leur écosystème politique national, ce qui alimente l’émergence de risques systémiques inédits pour les chaînes de valeur numériques globales notamment en termes d’exfiltration de données, d’opacité des modèles et de difficulté de traçabilité.

On passe d’une dépendance visible (énergie, composants) à une dépendance logicielle diffuse et difficilement traçable, que l’auteur de l’article publié dans War on the Rocks appelle à corriger de la façon suivante :

- Contrôle de la diffusion des modèles (surveillance des modèles « open weight » – c’est-à-dire un peu plus auditables que les modèles fermés -, restrictions ou cadres d’usage) ;

- Normes de sécurité pour les modèles (audits, tests, certification, équivalent de normes industrielles appliquées à l’IA) ;

- Approche écosystémique (coopération avec les alliés, structuration d’un bloc technologique sécurisé) ;

- Réduction de dépendance (développement de modèles nationaux, soutien aux alternatives non chinoises)[6].

Cette vulnérabilité rejoint directement les préoccupations alliées. L’OTAN identifie l’intelligence artificielle comme un levier central de transformation opérationnelle, au service de la connaissance de la situation, de l’accélération de la décision et de l’intégration multi-domaines. Elle insiste toutefois sur un point clé : la fiabilité et la sécurité des systèmes (« trustworthiness »), impliquant maîtrise des données, capacité d’audit et résilience face aux biais.

Dans ce contexte, les modèles d’IA doivent être considérés comme des capacités critiques, intégrées aux politiques de sécurité et développées dans des cadres de confiance.

Cela rejoint les préoccupations plus larges de résilience des chaînes d’approvisionnement, désormais étendues aux systèmes numériques et cognitifs. Dans ce contexte, le statut même des systèmes d’IA évolue, les modèles d’IA devant être considérés comme des capacités critiques intégrés dans les politiques de sécurité OTAN, soumis à des processus de certification et de test et développés dans des cadres de confiance (alliés, partenariats sécurisés).

A l’image des réseaux de communication ou des systèmes d’armes, l’IA est d’ores et déjà devenu un élément structurant de la supériorité opérationnelle.

La résilience de l’architecture d’aide à la décision en milieu dégradé et/ou en haute intensité

Ces évolutions doctrinales et technologiques posent enfin une question centrale : celle de la résilience de l’architecture d’aide à la décision en environnement dégradé ou de haute intensité.

Au-delà de ces considérations fondamentales, l’intégration des modèles d’IA dans les systèmes de commandement illustre une transformation plus profonde de la conduite des opérations. L’objectif poursuivi par les forces armées est de maintenir la supériorité militaire grâce à la capacité à analyser plus vite que l’adversaire et à accélérer le cycle décisionnel. Ce que la doctrine américaine actuelle résume dans le principe d’avantage décisionnel (« Decision advantage »).

Dans ce contexte, l’intelligence artificielle est considérée comme un multiplicateur de puissance, capable de transformer la masse de données disponibles sur le champ de bataille en avantage opérationnel. L’IA doit donc augmenter l’intelligence humaine sans la remplacer, et l’entraînement doit permettre de continuer à combattre lorsque l’IA disparaît.

Le problème – au moins à court et moyen termes – est que toute cette architecture d’aide à la décision repose sur des infrastructures extrêmement fragiles, dès lors que les forces doivent opérer en environnement contesté, en milieu dégradé ou en haute intensité. Les systèmes issus de programmes comme Project Maven ou les plateformes d’intégration comme celles de Palantir Technologies supposent en effet plusieurs conditions pour fonctionner de façon optimale (condition sine qua non de la fiabilité et de la confiance qu’il est possible d’avoir dans toute technologie en temps de guerre) : connectivité au réseau, accès aux données, puissance de calcul et alimentation énergétique.

Or les conflits récents montrent que ces éléments sont précisément les premières cibles : brouillage, cyberattaques, destruction des relais de communication, frappes sur les infrastructures électriques font partie des options jugées prioritaires. Faire en sorte que ces systèmes continuent de fonctionner en environnement contesté et dégradé est le défi qui permettra de passer du mode préparation opérationnelle au déploiement en l’état jusqu’au niveau tactique.

Un certain nombre de technologies existent déjà permettant de poursuivre l’expansion de l’IA comme « assistant cognitif » sur le champ de bataille, en en renforçant la robustesse, au premier rang desquelles l’« edge AI » ou IA de proximité (la traduction française généralement retenue est celle d’ « intelligence artificielle en périphérie du réseau »[7]).

Par « edge AI », on désigne l’exécution de modèles d’IA directement sur les plateformes de terrain – capteurs, drones, véhicules ou terminaux tactiques – plutôt que dans des centres de données distants, ce qui réduit la latence, limite la dépendance aux liaisons de données vulnérables et permet de maintenir des fonctions critiques de détection, de tri et de priorisation même en environnement dégradé[8].

L’expérience ukrainienne avec le système de gestion de bataille Delta illustre une telle évolution : en combinant agrégation de données multi‑capteurs et modules d’IA capables d’identifier et de classer automatiquement des milliers de cibles russes par semaine, l’écosystème Delta/Avengers fonctionne comme un véritable assistant cognitif pour les états-majors et les unités de contact, en comprimant la boucle « sensor-shooter » dans des conditions de brouillage et de dégradation permanente des infrastructures[9].

La mise en œuvre de tels assistants et du développement de l’IA embarquée demeurent toutefois indissociable d’une infrastructure énergétique distribuée, capable de soutenir en continu des charges de calcul significatives au plus près du front : batteries haute densité, micro‑générateurs, micro‑réseaux tactiques et systèmes de gestion intelligente de l’énergie forment un écosystème de soutien de l’IA de combat aussi essentiel que les algorithmes eux‑mêmes. La résilience énergétique au niveau tactique est ainsi considérée comme un « pilier central de la préparation opérationnelle des forces »[10].

Les risques de la dépendance cognitive : être capable de faire avec, mais aussi sans

Mais comme pour la dépendance au GPS ou autre innovation technologique de rupture, la formation militaire généralement inclut le retour à la boussole et la carte papier « au cas où ». En ce qui concerne l’IA, la rupture est telle, que nombre d’experts s’interrogent évidemment sur ses conséquences sur la capacité à terme du cerveau à fonctionner normalement sans béquille numérique. Un risque a de fait déjà été identifié sous le nom de « biais d’automatisation », à savoir la tendance à suivre la recommandation de la machine même lorsque celle-ci est incorrecte, dans la mesure où les soldats s’habituent à ce qu’un système leur propose toujours les options optimales.

Si ce sujet est depuis longtemps étudié dans l’aviation, il est en passe de devenir de plus en plus critique de manière transversale avec les systèmes d’IA[11]. Les Armées commencent donc à réfléchir à plusieurs garde-fous :

- Premièrement, maintenir des capacités de raisonnement indépendantes, ce qui passe donc par l’entraînement : les exercices incluent donc des scénarios où les systèmes numériques sont dégradés ou coupés.

- Deuxièmement, développer des systèmes explicables. L’IA ne doit pas seulement proposer une option, mais expliquer sur quelles données et quels raisonnements elle s’appuie. L’objectif est que l’humain reste capable de comprendre la logique de la recommandation.

- Troisièmement, préserver ce que certains stratèges appellent la « résilience cognitive » : la capacité d’un combattant ou d’un commandant à continuer à décider correctement même en l’absence totale d’assistance technologique.

Vérité première dans le domaine de la pensée militaire, la technologie peut améliorer la guerre, mais elle ne remplacera jamais le jugement humain et la capacité d’un soldat à improviser reste essentielle, spécialement dans un environnement de guerre de haute intensité. Les officiers tendent ainsi à considérer l’IA comme un outil d’entraînement et d’augmentation, et non comme une béquille permanente. La préparation opérationnelle s’avère donc naturellement tout à la fois un lieu d’apprentissage de l’IA et un espace critique pour apprendre à s’en affranchir.

L’intelligence artificielle conversationnelle s’impose ainsi comme un levier majeur de transformation de la préparation opérationnelle, en facilitant l’appropriation de systèmes complexes et en accélérant l’apprentissage de logiques multi-domaines devenues particulièrement exigeantes. Elle contribue à renforcer l’acculturation et la maîtrise de l’IA au sein des forces et à préparer les décideurs à un environnement où la compréhension de la situation et la génération d’options reposent de plus en plus sur l’exploitation de la donnée.

Cette capacité suscite cependant un dilemme, car, en simplifiant l’accès à la complexité, ces outils peuvent aussi favoriser une forme de dépendance cognitive et introduire une médiation algorithmique dans la décision humaine, susceptible d’en modifier les équilibres. Dès lors, la question n’est pas tant de savoir si l’IA conversationnelle renforcera le commandement par intention, mais à quelles conditions elle pourra le faire sans en altérer les fondements. De la même manière que l’essor de l’intelligence artificielle appelle une adaptation en profondeur des systèmes éducatifs dans la société civile, la préparation opérationnelle apparaît, dans le domaine militaire, comme le lieu décisif de cette transformation : non seulement pour apprendre à exploiter ces outils, mais aussi pour en éprouver les limites et préserver, en toutes circonstances, la capacité d’initiative, de discernement et de responsabilité qui demeure au cœur de l’action militaire.

Notes et références :

[1] Voir par exemple : https://www.reuters.com/world/how-anthropic-pentagon-dispute-over-ai-safeguards-escalated-2026-03-11/

[2] https://blog.palantir.com/maven-smart-system-innovating-for-the-alliance-5ebc31709eea

[3] https://defensescoop.com/2025/04/14/nato-palantir-maven-smart-system-contract/

[4] Colonel Bruno De San Nicolas, Commandement et contrôle à l’ère du multidomaine : entre efficacité alliée, souveraineté numérique et agilité opérationnelle, Revue de la Défense Nationale n° 887, février 2026.

[5] https://www.latribune.fr/article/tech/intelligence-artificielle/1986408584800/lia-chinoise-a-siphonne-30-du-marche-mondial-cette-annee

[6] Ryan Fedasiuk, China’s AI Is Spreading Fast. Here’s How to Stop the Security Risks, April 1, 2026, https://warontherocks.com/2026/04/chinas-ai-is-spreading-fast-heres-how-to-stop-the-security-risks/

[7] https://www.lemagit.fr/definition/Quest-ce-que-lIA-en-peripherie

[8] https://www.csis.org/blogs/strategic-technologies-blog/harnessing-edge-ai-strengthen-national-security

[9] Voir par exemple sur ce sujet : https://cepa.org/article/the-heart-of-war-ukraines-key-battlefield-system/

[10] Voir notamment :

Delaporte M., Vers une IA soutenable dans les Armées ?, 9 octobre 2025, https://www.eurosatory.com/vers-une-ia-soutenable-dans-les-armees/

[11] Voir par exemple : M.L. Cummings, Automation Bias in Intelligent Time Critical Decision Support Systems, Massachusetts Institute of Technology, American Institute of Aeronautics and Astronautics, 2023 : https://maritimesafetyinnovationlab.org/wp-content/uploads/2023/02/Automation-Bias-in-Intelligent-Time-Critical-Decision-Support-Systems.pdf

Photo et illustration :

1. Formation au Maven Smart System : un officier de l’U.S. Army exploite une interface d’analyse de données multi-sources, illustrant l’intégration croissante de l’IA dans les processus de décision opérationnelle © Master Sgt. Whitney Hughes, US Army, Arlington, Virginie, Etats-Unis, 20 février 2020

2. Source : Joint Air Power Competence Center, 2021 : https://www.japcc.org/essays/human-on-the-loop/